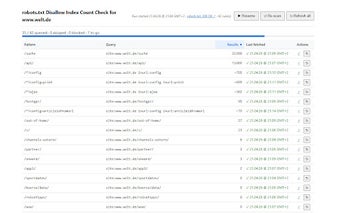

効率的なロボットの禁止チェッカー for Chrome

Robots Disallow Checkerは、ウェブサイトがrobots.txtファイルで禁止しているパスを監査するために設計された無料のChrome拡張機能です。このツールは特にGooglebotをターゲットにしており、Disallowルールを抽出し、それをGoogleのsite:クエリに変換します。これにより、禁止されているにもかかわらずGoogleにインデックスされているURLの数を効果的に強調し、ウェブマスターが大規模なインデックスの問題を特定しやすくします。

最もおすすめの代替ソフト

この拡張機能は、プレーンプレフィックス、ワイルドカード、およびURLエンコードされたパスを含むさまざまなrobots.txtパターンをサポートしています。結果のためのソート可能なテーブルを備えたユーザーフレンドリーなインターフェースを特徴とし、ユーザーはTSVまたはMarkdown形式でデータをコピーすることができます。迅速な監査のためのローカルキャッシングシステムと、個人データを収集しないプライバシー重視のデザインを備えたこのツールは、SEO専門家やウェブマスターにとって貴重な資産です。